La llegada de los VLA

Grandes movimientos por parte de Google y NVIDIA para dar un nuevo gran impulso al desarrollo de los robots humanoides.

Hacer predicciones siempre es arriesgado, pero si me atrevo a decir que la entrada de Google en el sector de la robótica humanoide con Gemini Robotics puede ser un nuevo catalizador para el impulso de este negocio, especialmente si lo sumamos a los impulsos anteriores que ya han realizado empresas como NVIDIA, Apple, Meta, Tesla, …

Estamos hablando de una situación que podría ser el equivalente a la aparición de Android para el desarrollo de los smartphones. Cuando Apple lanzaba su iPhone, muchos otros fabricantes de teléfonos inteligentes andaban buscando un sistema operativo que sacase todo el potencial de ese tipo de dispositivos. Por aquel entonces Nokia aún era competitivo en ese negocio e intentó imponer sus sistema operativo Symbian, pero como te puedes imaginar no lo logró. Del mismo modo Microsoft hizo su intento, pero igualmente fracasó, algo que ha tenido a posteriori un impacto muy importante en el sector tecnológico.

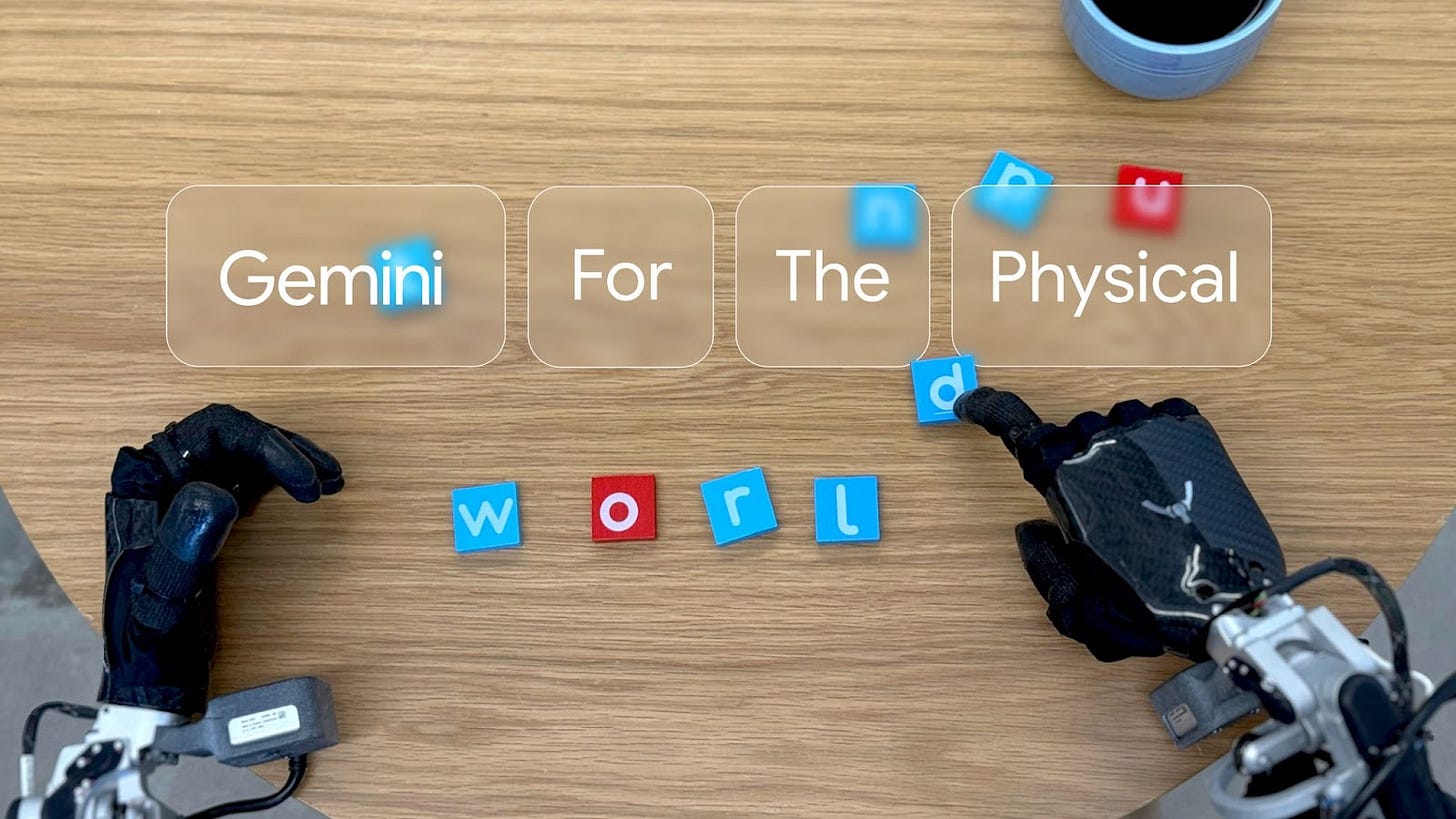

Entonces, cuando muchos vaticinan que el próximo gran producto de hardware, tras los smartphones, podrían ser los robots humanoides, llega Google DeepMind y presenta sus modelos de Inteligencia Artificial que permiten a los robots comprender cómo es el mundo físico, lo que les ayudará a realizar todo tipo de actividades en el mundo real.

En concreto Google ha presentado dos modelos de Inteligencia Artificial, por un lado tenemos al VLA, unas siglas que significan Visión, Lenguaje y Acción, y que os sonarán porque Figuere también se ha referido a ellas al presentar su modelo Helix. Y por otro lado está el modelo de razonamiento que permite a los robots entender cómo funciona el mundo real, o dicho de otro modo, las condiciones físicas del espacio en tres dimensiones en el que se mueven.

Por lo tanto, podríamos hacer una comparación entre los LLM, que serían algo más parecido a la corteza prefrontal, en cuanto a capacidad de razonamiento, mientras que los VLA estarían más relacionados con las partes del cerebro encargadas de dotarnos de los diferentes sentidos que nos permiten tomar acción para desenvolvernos por el mundo.

Aunque esta comparación puede ser poco precisa, lo cierto es que la necesidad de contar con diferentes modelos de Inteligencia Artificial es algo que también había hecho NVIDIA al crear Cosmos como modelo fundacional del mundo para la IA Física e Isaac GR00T como modelo más parecido a un VLA. Aunque no hay una correspondencia directa entre modelos, sí que es cierto que ambas empresas coinciden en la necesidad de disponer de mejor software para el entrenamiento y desempeño de los robots, especialmente en lo relativo a cómo entienden el mundo físico que les rodea.

La llegada de los VLA

Los VLA son para los robots lo que los LLM han sido para los chatbots. Antes de la llegada de los LLM los chatbots estaban dotados de un tipo de Inteligencia Artificial con muy poca autonomía, básicamente tenían la capacidad de entender el lenguaje de los humanos pero su capacidad de razonar y actuar a posteriori era muy limitada. Si no habían sido programados específicamente para responder a cada pregunta o hacer determinadas tareas, se quedaban bloqueados y no eran capaces de avanzar en la conversación. Sin embargo con los LLM esto ha cambiado radicalmente y ahora sí se puede decir que son Inteligentes, al menos para las tareas que mejor saben hacer, como es la generación de contenidos.

Así que la capacidad de entender el lenguaje humano ha sido fundamental para que ahora podamos tener LLM y lo va a ser también para el desarrollo de los VLA. Para ello han sido necesarias décadas de investigación en procesamiento de lenguaje natural (PLN) y ahora comienza a verse la utilidad de toda esta inversión. Del mismo modo en lo relativo a la visión por computadora que permite el reconocimiento de imagen, que ya lleva tiempo ofreciendo resultados en el ámbito de la conducción autónoma y ahora va a tener aún más protagonismo para el desarrollo de la robótica. Y el tercer elemento de la fórmula es la capacidad de acción para lo cual también ha sido mucho tiempo de desarrollo en lo relativo a toda la parte física de los robots, como son los sensores y actuadores de los que ya os he hablado antes por aquí.

Apptronik y Agility elegidos por Google

Los nombres de Apptronik y Agility comienzan a aparecer en muchas quinielas como algunas de las empresas más avanzadas en cuenta a robots humanoides se refiere. Si no fuera así seguramente no habrían sido elegidas por Google para colaborar en el despliegue de Gemini Robotics.

El caso es que Apptronik además acaba de anunciar que su ronda de inversión se ha ampliado dando entrada a Mercedes-Benz, lo cual pone de manifiesto que los fabricantes de automóviles también han puesto la vista en los robots humanoides como destino para sus inversiones y quién sabe si incluso para la evolución de su modelo de negocio. Al menos eso podemos pensar si nos fijamos en la colaboración de Neura con Volvo, de Figure con BMW y de Apptronik con Mercedes. Ni que decir tiene que en China también nos encontramos por apuestas en este sector por parte de XPENG y BYD entre otros.

Por cierto, también los robots Apollo de Apptronik y Digit de Agility aparecen en las demostraciones que hace NVIDIA cuando presenta sus avances en la estrategia de desarrollo de la IA Física, de lo cual vamos a hablar a continuación.

NVIDIA vuelve a mover ficha

Let's talk about Robots: the next multi-trillion dollar industry. Ha llegado el momento de los robots. Los robots tienen la ventaja de poder interactuar con el mundo real, algo que la información digital no puede hacer. Sabemos claramente que el mundo tiene una grave escasez de mano de obra humana. Para finales de esta década el mundo tendrá 50 millones menos de trabajadores y estaríamos encantados de pagar a cada uno 50 000 dólares para ir a trabajar, entonces probablemente tendremos que pagar esos 50 000 dólares a los robots y por eso esta será una gran industria.

Así que resulta que cuando aún estamos procesando la entrada de Google en el campo de la robótica con Gemini Robotics, en pocos días volvemos a tener noticias de los avances de NVIDIA en este sector. Se trata concretamente de la presentación de dos modelos:

💡 Newton como un motor de física de código abierto para simulación robótica que permite a los robots percibir, interpretar, razonar e interactuar con el mundo real de forma autónoma.

🫚 Isaac GR00T N1 un modelo de código abierto del mundo para el razonamiento y las habilidades generalizadas de robots humanoides. Este modelo multi-corporal utiliza entradas multimodales, como lenguaje e imágenes, para realizar tareas de manipulación en diversos entornos. Además utiliza un modelo de pensamiento rápido y lento, inspirados en los principios del procesamiento cognitivo humano, como vimos que hace también Helix de Figuere.

En esta ocasión NVIDIA ha trabajado con Google DeepmMind y Disney para el desarrollo de Newton, lo cual permite cerrar el círculo en este artículo en el que hemos explorado cómo los VLA están cada vez más cerca de suponer para la robótica lo que los LLM han supuesto para la IA en los últimos años.

Todo lo que se mueva será autónomo. La IA física encarnará robots de todo tipo en cada industria. Para ello NVIDIA ha construido tres computadoras que permiten realizar el ciclo completo de simulación, entrenamiento y pruebas en el mundo real de los robots.

Entrenar robots requiere enormes volúmenes de datos. Los datos a escala de Internet proporcionan a los robots sentido común y razonamiento, pero también necesitan acción y datos de control, que son costosos de capturar. Y aquí es donde entran en juego Omniverse, como el sistema operativo de la IA física, y Cosmos que permiten la generación masiva de datos sintéticos para entrenar políticas de robots.

La IA Física y la robótica están avanzando muy rápido. Todos prestan atención a este espacio. Esta podría ser muy probablemente la industria más grande de todas. Jensen Huang.

Más noticias destacadas del sector de la robótica y la Inteligencia Artificial

🚲 Agibot aprende a montar en bicicleta y otro montón de destrezas que se pueden observar en este espectacular vídeo compartido por la compañía china.

🏭 BotQ es la nueva planta de fabricación masiva construida por Figure y tendrá capacidad para fabricar hasta 12 000 robots humanoides al año.

🧑💻 Hui Si Kai Wu es la plataforma de inteligencia diseñada por el Centro de Innovación de Robótica Incorporada de IA para mejorar la autonomía robótica para su robot Tien Kung.

🧿 MIT ha presentado un músculo artificial que puede moverse en múltiples direcciones, imitando el funcionamiento del iris de un ojo.

🔬 Lila Sciences ha recaudado 200 millones de dólares en financiación para el desarrollando de una plataforma y la construcción de las primeras fábricas de ciencia de IA

🌿 Bambot es una absoluta maravilla del ingenio humano, una idea de Tim Qian que a buen seguro ayudará muchísimo a impulsar el aprendizaje sobre robots humanoides.